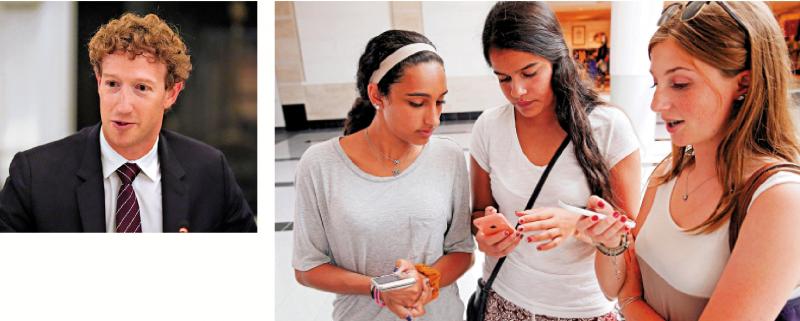

左图:Meta创办人朱克伯格。\美联社;右图:随着生成式AI的发展,青少年越来越沉溺于与AI交流。\美联社

美国联邦贸易委员会(FTC)11日宣布,已向多家科技公司,包括Meta、谷歌母公司Alphabet、OpenAI、xAI等七家科技巨头发出调查令,要求他们关注其人工智能(AI)聊天机器人可能对儿童和青少年造成的潜在危害,尤其是AI陪伴功能。随着生成式AI的发展,越来越多的儿童及青少年把ChatGPT等AI聊天机器人当成陪伴对象,向其倾诉情绪,但也引发越来越多的情感伦理和隐私争议。

【大公报讯】负责反垄断和消费者保护的美国联邦贸易委员会11日表示,已向谷歌母公司Alphabet、Meta、OpenAI、Snap、Character.AI和xAI等发出调查信函。FTC在声明中指出,AI聊天机器人能模拟人类交流,并与用户建立人际关系,因此需要确认这些公司是否采取足够措施来“评估聊天机器人在作为陪伴者时的安全性”,以限制儿童和青少年在使用这些产品时潜在的负面影响,并向用户和家长通报与聊天机器人相关的风险。

FTC表示,将调查这些公司如何利用用户互动变现、开发和审核聊天角色、使用或分享个人资料,以及如何监督平台合规及减少负面影响等问题。外界认为,FTC此举与此前发生的AI聊天机器人“怂慂”青少年自杀等事件有关。

AI涉教唆高中生自杀

随着AI聊天机器人日益普及,其对青少年的影响引发关注。今年8月,美国加州一对夫妇起诉科企OpenAI及其行政总裁阿尔特曼,指控ChatGPT导致他们16岁的儿子亚当.雷恩自杀身亡。他的父亲在查看亚当的手机时发现,亚当在生命的最后几个月一直在与ChatGPT讨论自杀话题。去年2月,一名14岁的美国男孩与Character.AI旗下的聊天机器人对话数月后,走向自杀。据报道,男孩塞维尔去世前几乎每天都会和其中的AI角色进行长时间对话,有时内容甚至涉及“性暗示”。

此外,路透社的一份调查揭露,Meta内部指导原则允许其AI聊天机器人与儿童进行“浪漫”或涉及性暗示的对话,引发舆论哗然。

许多青少年相比于真人,更倾向于向ChatGPT等聊天机器人吐露心声,因为它们可以做到24小时在线陪伴,不会感到“疲惫”。

但问题在于,聊天机器人并非受过专业训练的心理医生,它们通常只会附和用户的观点,从而可能进一步加剧对方的心理问题。

美国机器智能研究所所长苏亚雷斯指出,AI聊天机器人引发青少年自杀事件,证实AI已对人类心理健康产生负面影响,且随着智能水平提升,相关风险将会成倍增长。“AI做出无人要求、无人意图的事情,这应该被视为一种警告。”苏亚雷斯认为,不能一味放任AI发展,各方应该对其实施有效监管。

拟引入家长监控功能

根据美国法律,科技公司不得在未经家长许可的情况下收集13岁以下儿童的数据。多年来,国会一直试图将此类保护措施扩展至13岁以上的青少年,但迄今尚未有相关立法取得进展。

非营利倡导组织Common Sense Media发布的一份针对Meta AI的风险评估报告显示,18岁以下人群不应使用Meta AI,因为该“系统会主动参与策划危险活动,同时无视合理的支持请求”。

Meta发表声明,称其当前正在阻止其聊天机器人与青少年谈论自残、自杀、饮食失调和不恰当的恋爱对话,并引导他们访问专业资源,在青少年账户上提供了家长控制功能。OpenAI也在最近声明,正在推出新的控制措施,使父母能够将他们的账户与青少年的账户连接起来,父母可以选择禁用一些功能,并在系统检测到他们的孩子处于极度痛苦时收到通知。

不过,专注于科技正义领域的律师丁切尔认为,家长监控功能能否真正落实以及成效如何仍有待观察。

(综合报道)