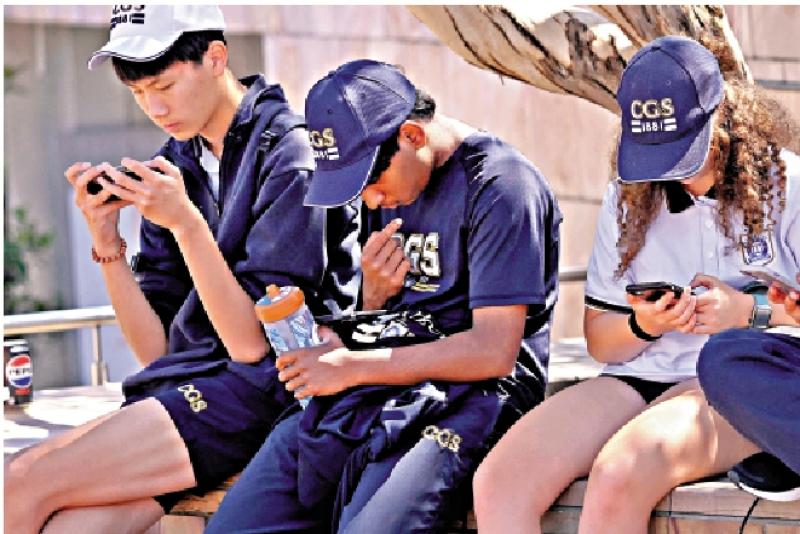

图:澳洲要求多家AI聊天机器人公司说明如何防止儿童接触到危险内容。图为墨尔本学生们正在看手机。\法新社

【大公报讯】据路透社报道:澳洲已向四家提供人工智能(AI)聊天机器人的公司发出通知,要求AI公司说明如何防止儿童接触到性内容或自残相关内容,显示澳洲当局正加强对AI领域的安全监管。

澳洲电子安全专员办公室在一份声明中说,已要求相关公司提供关于防范儿童性剥削、色情,以及宣扬自杀或饮食失调内容的具体保障措施。收到通知的公司包括AI聊天机器人Character.ai的母公司Character Technologies,以及竞争对手Glimpse.AI、Chai Research和Chub AI。

根据澳洲的线上监管体系,电子安全专员有权要求互联网企业报告内部安全流程,若企业拒不回应,将面临每日最高82.5万澳元(约合417万港元)的罚款。澳洲电子安全专员格兰特表示:“这些服务也有阴暗的一面,许多聊天机器人能够与未成年人进行露骨的性对话……有人担心,它们还可能鼓励自杀、自残和饮食失调行为。”

聊天机器人在澳洲的用户正快速上升,仅Character.ai每月就拥有近16万名澳洲活跃用户。澳洲电子安全专员办公室指出,澳洲一些学校报告,年仅13岁的孩子每天与聊天机器人对话长达5小时,有时涉及性话题;未成年人因此有可能与这些机器人形成性或情感依赖关系,或被激发自残行为。

澳洲近年加强监管社交媒体,防止其对青少年儿童产生不良影响。自今年12月起,社交媒体公司必须停用或拒绝16岁以下用户的账户,否则将面临最高4950万澳元(约合2.5亿港元)罚款。